Actualités

-

Vers un Gefilte Fish encore meilleur : Les carpes résistantes aux maladies ouvrent de nouvelles voies pour la tradition de Pessah

À l’approche de la fête de Pessah, une récente recherche menée à l’Université Hébraïque de Jérusalem a ouvert de nouvelles perspectives pour améliorer l’un de nos mets traditionnels de vacances…

-

Le Prof. Avi Wigderson de l’Université a remporté le prestigieux prix Turing 2023

L’Université Hébraïque de Jérusalem adresse ses sincères félicitations à l’ancien membre du corps professoral de l’Université, le Professeur Avi Wigderson, pour avoir été honoré du prestigieux prix Turing pour ses…

-

Des mini-melons parfaitement adaptés à une seule portion : la nouvelle découverte de l’Université

Imaginez un melon de petite taille que vous pouvez tenir dans votre main et manger en une seule fois. Des scientifiques israéliens de l’Université Hébraïque et de l’Institut Volcani, une…

Évènements

-

Voyage en Israël du 1 au 4 juin : 87e Assemblée Générale à Jérusalem

Lors de la visite cette semaine à Paris de Yossi Gal, Vice-Président de l’Université, nous avons ressenti l’importance du soutien que représente notre participation à…

-

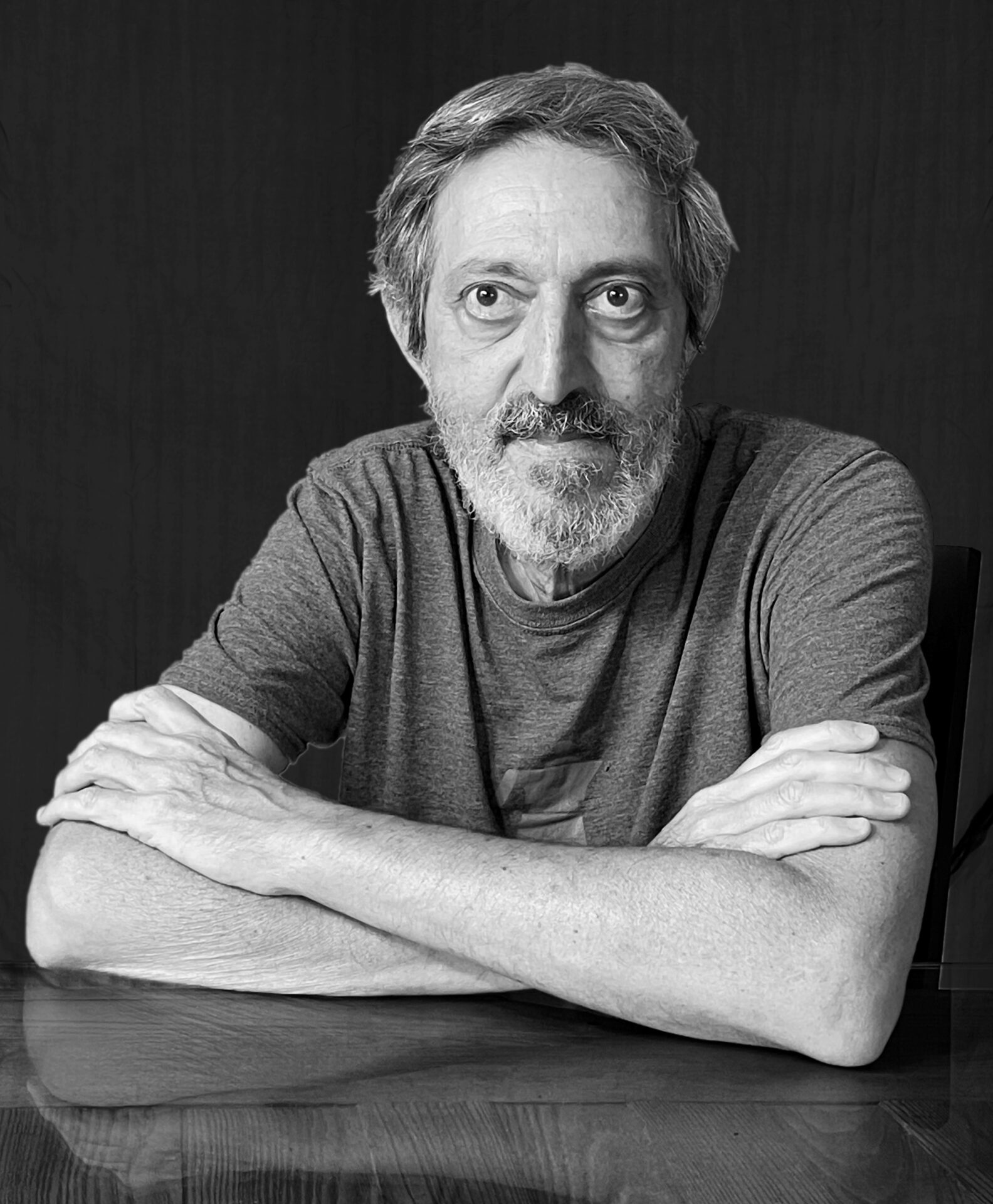

Les origines du 7 octobre : Conférence avec Georges Bensoussan

Retrouvons nous à nouveau pour analyser et échanger sur la situation actuelle. Notre deuxième invité pour cette série de conférences : l’historien français, Georges Bensoussan,…

-

Décrypter et agir : Déchiffrer l’actualité avec Manuel Valls, quels impacts sur nos démocraties ? Que faire ?

Face au séisme géopolitique, à la fragilité de la démocratie, nous vous proposerons de nous retrouver ces prochains mois à l’occasion de rencontres avec des personnalités…

LE PREMIER EMPLOYEUR DE JÉRUSALEM

6 campus, 7 facultés, 14 écoles, 315 départements, 1 300 enseignants,

25 000 étudiants, dans le Top 100 mondial, dans le top 20 en mathématiques

Transfert de technologie

55 ans de transferts de technologies

10 750 Brevets

2 869 Inventions (150/ans)

950 Licences

125 Entreprises dérivées

Distinctions et récompenses

298 Prix d’Israël

100 Prix Rothschild

49 Prix EMET

14 Prix Wolf

8 Prix Nobel

1 Médaille Fields en Mathématiques

1 Prix international Canada Gairdner

1 Prix Turing en Informatique

Classement de Shanghai

N°1 en Israël

N°77 dans le monde

N°17 en Communication

N°17 en Mathématiques

N°30 en Droit

Recherche

Plus de 100 Centres de recherche

3 842 Projets de recherche

6 hôpitaux affiliés

+ de 1/3 des étudiants en PhD en Israël

43% des recherches en biotechnologies d’Israël